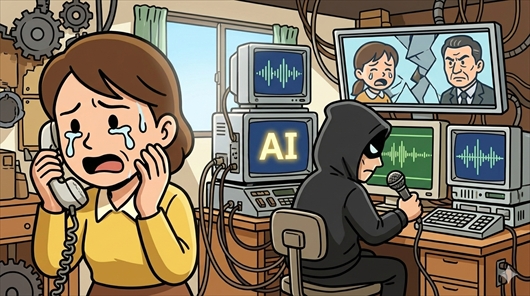

「もしもし?」その3秒で破滅…AI時代の最新オレオレ詐欺が恐ろしすぎる

会社のCEOから慌てた様子で「いますぐ送金してくれ!」と電話がかかってきたら?また、娘から泣き声で「誘拐された、助けて」と電話がかかってきたら、あなたはどうするだろうか? 聴き慣れた声だし、本人と通話もしているし……と信じたら、あなたはだまされてしまうかもしれない。なぜなら、生成AIの発展によって最新の「オレオレ詐欺」は恐ろしくレベルアップしているからだ。

AIで声を偽装!高度化する「音声犯罪」

国内のとある企業で、最新型の「オレオレ詐欺未遂」と呼ぶべき事例が発生している。

出張中のCEOを名乗る人物から社に電話があり、部下に緊急送金を命じる内容だったという。幸い未遂に終わったが、恐ろしいのはこの「CEOの声」が本人そっくりだったということだ。企業サイトのインタビュー動画などからCEOの音声を抽出し、クローンを作成したものとみられている。

こうした事例は電話だけではない。2025年11月には、Zoom会議に「AIで生成した役員の顔と声」で参加し、機密情報を聞き出そうとしたディープフェイク事例も確認されている。

海外に目を向けると、さらに悲惨な例がある。これも2025年のことだ。

母親のもとに、娘から「誘拐された、助けて」と泣き叫ぶ電話が入った。単なるクローン音声ではなく、泣き声や息遣いまでAIで再現されていた。パニックに陥った母親は、確認する間もなく100万円以上を犯人に送金してしまった。電話をかけたときには娘はすでに殺害されており、二度と母親のもとへは戻らなかったという。技術の悪用がもたらした、最悪の結末である。

AIボイスクローン~3年前からすでに警鐘は鳴らされていた

AIを使った「音声クローン犯罪」については、数年前から警告が出ていた。米国では2023年3月、FTC(米連邦取引委員会)がすでに以下のような注意喚起を公開している。「AIボイスクローニング(音声複製)」を悪用した、従来のオレオレ詐欺の巧妙化についての警告だ。

従来の「孫を装うオレオレ詐欺」では、受け手が「本当に孫の声か?」と疑う余地があった。しかし今やAIで本人の声をそっくりに複製できるため、その疑念すら持ちにくくなっている。

犯人は本人の短い動画(SNSなどに投稿された、数秒から数十秒の動画でいい)から音声サンプルを抽出し、それをAIソフトに取り込むだけで、その人特有の話し方や声色を再現した「クローン音声」を自由に発話させることができる。「交通事故を起こした」「逮捕された」「強盗に遭った」などのセリフをしゃべらせ、パニック状態を演出し、被害者の冷静な判断を奪う。声が本人そっくりなだけに、信じ込んでしまう被害者が後を絶たない。

FTCは対策として、次の3点を挙げている。

(1)「声を信じない」:いったん電話を切り、本人の知っている元の番号へかけ直すか、別の家族を通じて確認する。

(2)「支払方法に注目」:銀行振込、暗号資産、ギフトカードでの支払いを要求されたら詐欺を疑う。

(3)「合言葉を決めておく」:家族間だけで通じる緊急時の合言葉を事前に決めておく。

「もしもし」の3秒でクローンが完成する時代

2023年当時、AIボイスクローニングには相応の計算リソースとスキルが必要だった。また、音声サンプルも「少なくとも30秒?数分のクリアな音声」が必要とされており、WebサイトやYouTubeのスピーチ動画、インタビュー動画などから音声を拾うのが一般的だった。

だが2026年現在、状況は劇的に変わっている。スマホアプリ1つで、わずか数秒のサンプルからリアルタイムに声を変換できるようになった。RVCの進化版やSpeech-to-Speech基盤モデルでは、わずか3秒程度の音声サンプルがあれば、イントネーションや感情の起伏まで含めたクローン生成が可能だ。

これは何を意味するか。たとえば「間違い電話」を装って電話をかけ、「もしもし? どなたですか? もしもし?」――これだけで約3秒。クローン作成に十分なデータが採取できてしまうのだ。

リアルタイム変換と「誰でも使える詐欺ツール」の脅威

技術の進歩は、悪意ある者をさらに有利にしている。特筆すべきは「リアルタイム性」の獲得だ。2023年頃までは「テキストを入力して音声を生成する」方式が主流で、会話に不自然なタイムラグが生じがちだった。しかし現在は「リアルタイム・ボイスチェンジャー」の精度が飛躍的に向上している。

犯人がマイクに向かって喋ると、AIが瞬時に「ターゲットの家族の声」へ変換して送出する。犯人の焦りや泣き声もそのままクローン音声に反映されるため、聞き手は「パニックで声が上ずっている」と解釈し、違和感を覚えることなく信じ込んでしまう。

しかもこれらのツールは、比較的容易に入手できる。AIプログラミングの知識は一切不要で、月額数千円程度で使える「誰でも使える詐欺ツール」がTelegramやダークウェブ上で流通している。「サービス化」によって、このような犯罪が誰にでも実行可能になってしまっているのだ。

結局、最強の対策は「家族の合言葉」

では、こうした「フェイク音声」によるオレオレ詐欺に、どう対抗すればよいのか(…続きを読む)。